La vita non è un test di Turing. Contro l’IA come nuova metrica sociale

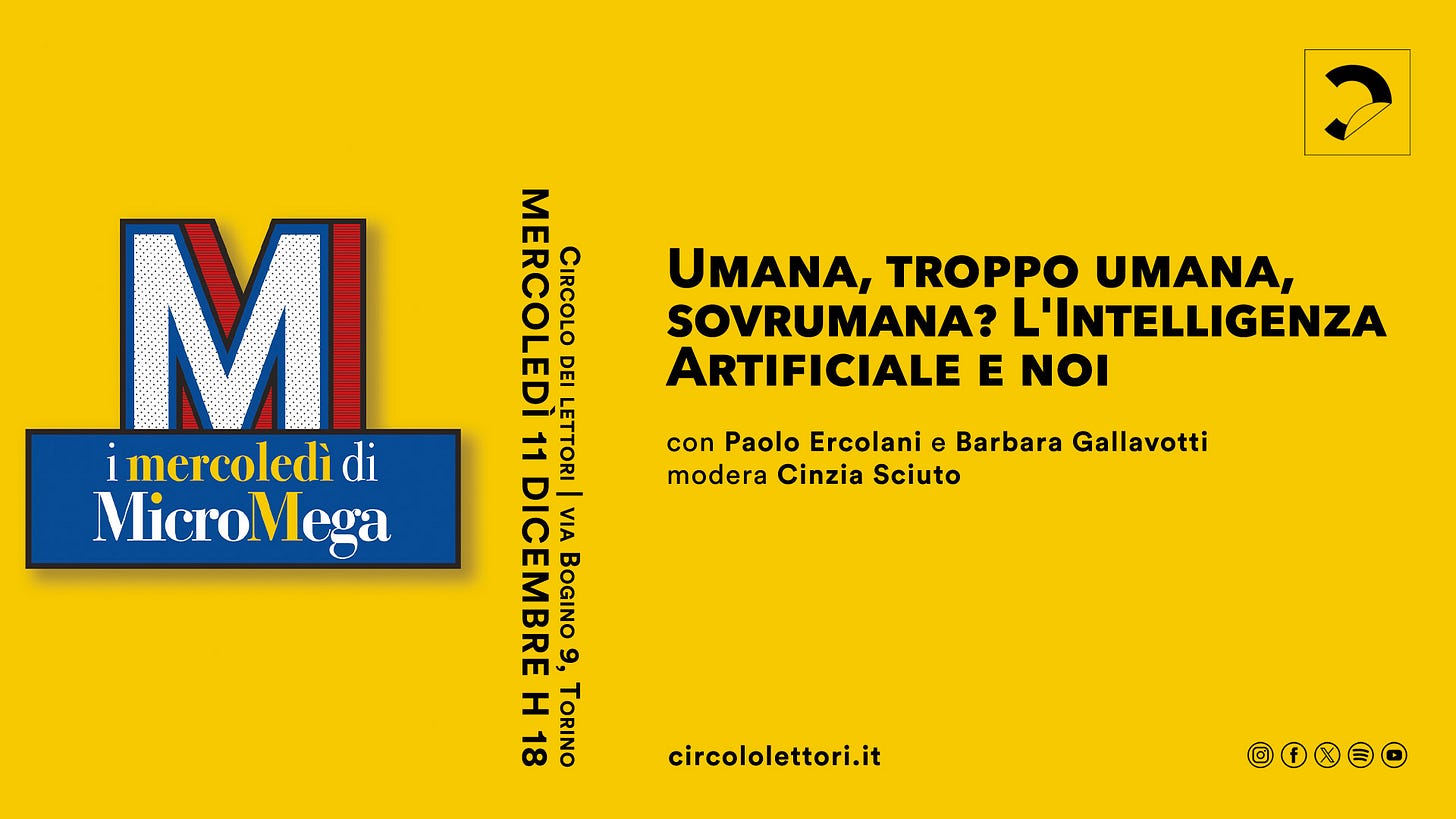

Un estratto dal volume 6/2024 di MicroMega dedicato all'Intelligenza Artificiale.

Condividiamo un estratto del saggio di Matteo Pasquinelli contenuto nel numero 6/2024 di MicroMega dedicato all’Intelligenza Artificiale.

La vita non è un test di Turing. Contro l’IA come nuova metrica sociale

di Matteo Pasquinelli

L’IA come misura dell’intelligenza umana (e non il contrario)

Il filosofo Alfred North Whitehead osservò un tempo: «La civiltà avanza estendendo il numero di operazioni importanti che possiamo eseguire senza pensarci». Whitehead sosteneva che l’automazione dei compiti più semplici e ripetitivi liberasse spazio mentale per pensieri più complessi, facilitando il progresso dell’intelletto umano e della civiltà. Sebbene spesso fraintesa ed estrapolata dal suo contesto, questa osservazione affronta un contrappasso rivelatore nell’era dell’IA. Se, da un lato, è vero che l’IA sta automatizzando e assumendo il controllo di molti compiti, rendendoci meno consapevoli delle mansioni che un tempo richiedevano un pensiero attivo (dal tradurre testi al gestire telefonate e persino programmare software, per esempio), dall’altro, essa ci rende più consapevoli dei nostri limiti e ci costringe a riflettere sul nostro valore attuale nel mercato del lavoro. La domanda che si pone non è più tanto la fantascientifica “L’IA è veramente intelligente?”, quanto la più prosaica “Potrà l’IA sostituire il mio lavoro?”. Ci ritroviamo in una dialettica storica senza pietà per l’autostima umana: con il progredire dell’IA, diventiamo non meno ma più consapevoli delle capacità che ci distinguono dalle macchine. Anziché smettere di pensare, come suggeriva Whitehead, finiamo per pensare un po’ troppo a quali delle nostre competenze saranno mappate, misurate e meccanizzate dall’algoritmo di un monopolio tecnologico. Posizioni tecno-entusiaste vedono questo processo di automazione come un processo virtuoso verso l’emancipazione sociale. Il presente saggio non specula sui risvolti di una possibile automazione di massa, quanto su un aspetto spesso tralasciato, ovvero sul ruolo della tecnologia come metrica implicita dell’umano.

L’IA non è una manifestazione di superintelligenza come certe vulgate, sia tecno-entusiaste che tecno-apocalittiche, sostengono. Al contrario, essa rappresenta una meccanizzazione dell’intelligenza media di una data società. Matematicamente parlando, l’IA funziona in base a una rappresentazione statistica (di certo estesissima, ma pure sempre statistica) della cultura umana codificata nella forma di archivi digitali (i cosiddetti training dataset). Sistemi di IA, come ChatGPT, elaborano enormi quantità di questi dati – testi, immagini e altro ancora – per poi generare previsioni e classificazioni basate sui valori medi di questi archivi digitali della conoscenza collettiva. È in un certo senso un modello statistico dell’essere umano medio epurato da estremismi e comportamenti anomali. Questo potere di normalizzazione insito nell’IA è già stato discusso da molti studiosi che hanno ricordato l’origine dell’apprendimento automatico (machine learning) nelle varie tecniche di calcolo della prima statistica (correlazione, deviazione standard, regressione logistica, analisi fattoriale eccetera), sottolineando l’uso discriminatorio che spesso si faceva di questi calcoli nel controllo dei comportamenti sociali alla fine dell’Ottocento. La vocazione normalizzante della statistica originaria si riflette e riconosce anche nell’IA contemporanea. […].